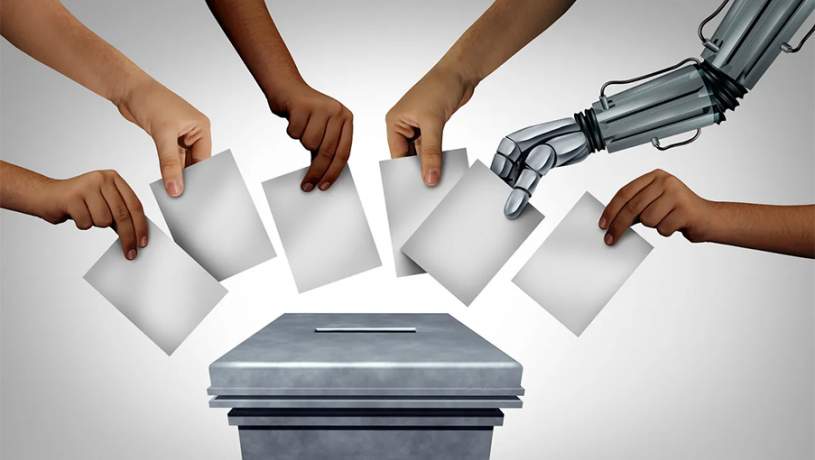

گفتوگو با هوش مصنوعی دیدگاه سیاسی را تغییر میدهد!

تاریخ انتشار

يکشنبه ۱۶ آذر ۱۴۰۴ ساعت ۰۹:۲۸

آیتیمن- مطالعهای که به تازگی در نشریه نیچر منتشر شده است، نشان میدهد که ترجیحات شرکتکنندگان در انتخابات واقعی تا حدود ۱۵ درصد پس از گفتوگو با یک چتبات تغییر کرد. همچنین در مقالهای مرتبط که در مجله ساینس منتشر شده است، پژوهشگران نشان دادند که کارایی این چتباتها از توانایی آنها در ترکیب مقدار زیادی اطلاعات به شکل یک مکالمه سرچشمه میگیرد.

دیوید رَند، یکی از نویسندگان هر دو مطالعه و دانشمند علوم شناختی در دانشگاه کرنل در ایتاکا، نیویورک میگوید: یافتهها قدرت اقناعی چتباتها را نشان میدهد که بیش از صد میلیون کاربر هر روز از آنها استفاده میکنند.

هر دو مقاله دریافتند که چتباتها دیدگاههای رأیدهندگان را نه با استفاده از احساسات یا داستانسرایی، بلکه با بمباران کاربر با اطلاعات تحت تأثیر قرار میدهند. هرچه اطلاعات بیشتری که چتباتها ارائه کردند، قانع کنندهتر بودند، احتمال بیشتری داشت که ادعاهای نادرست تولید کنند.

لیزا آرگایل، دانشمند علوم اجتماعی محاسباتی در دانشگاه پردو در وستلافایت، ایندیانا میگوید: این میتواند هوش مصنوعی را به «چیزی بسیار خطرناک» تبدیل کند، به جای اینکه مردم آگاهتر شوند، این مردم هستند که بیشتر ناآگاه میشوند. او اضافه میکند که این مطالعات «دامنه چشمگیری» دارند. مقیاسی که آنها همهچیز را مطالعه کردهاند بسیار فراتر از چیزی است که معمولا در علوم اجتماعی انجام میشود.

برای فهم اینکه هوش مصنوعی تا چه اندازه میتواند در باورهای سیاسی قانع کننده باشد، پژوهشگران از نزدیک به ۶۰۰۰ شرکتکننده از سه کشور کانادا، لهستان و ایالات متحده خواستند که ترجیحات خود را درباره نامزدهای خاص در انتخابات رهبری کشورشان که در سال گذشته برگزار شده بود، در مقیاس صفر تا ۱۰۰ امتیازدهی کنند. سپس پژوهشگران شرکتکنندگان را بهصورت تصادفی تعیین کردند تا گفتوگوی رفتوبرگشتی با چتباتی داشته باشند که برای حمایت از یک سیاستمدار خاص طراحی شده بود. پس از این گفتوگو، شرکتکنندگان بار دیگر نظر خود را درباره آن نامزد، امتیازدهی کردند.

بیش از ۲۳۰۰ شرکتکننده در ایالات متحده این آزمایش را پیش از انتخابات ۲۰۲۴ بین رئیسجمهور دونالد ترامپ و معاون سابق رئیسجمهور کامالا هریس تکمیل کردند. وقتی نامزدی که چتبات برایش طراحی شده بود با ترجیح اولیه شرکتکننده متفاوت بود، امتیاز فرد بین دو تا چهار واحد به سوی آن نامزد تغییر پیدا میکرد. پژوهشهای قبلی نشان دادهاند که دیدگاههای مردم معمولا پس از دیدن تبلیغات سیاسی معمول کمتر از یک واحد تغییر میکند.

این اثر برای شرکتکنندگان در کانادا و لهستان که آزمایش را پیش از انتخابات کشورشان در اوایل امسال تکمیل کردند، بسیار قابل توجهتر بود: ترجیحات آنها بهطور متوسط حدود ۱۰ واحد پس از گفتوگو با چتبات به سمت نامزد دیگر منتقل شد. رند میگوید او از اندازه این اثر «کاملا مات و مبهوت» شده بود. او اضافه میکند که تأثیر چتباتها ممکن است در ایالات متحده ضعیفتر بوده باشد بهخاطر محیط سیاسی قطبی، که در آن مردم پیشفرضها و احساسات شدیدی نسبت به نامزدها دارند.

در همه کشورها، چتباتهایی که بر سیاستهای نامزد تمرکز داشتند، قانعکنندهتر از آنهایی بودند که بر شخصیتها تمرکز میکردند. به نظر میرسید که شرکتکنندگان زمانی بیشتر تحتتاثیر قرار میگیرند که چتبات شواهد و حقایق ارائه میداد. برای رایدهندگان لهستانی، درخواست از چتبات برای ارائه نکردن حقایق باعث شد قدرت اقناعی آن تا ۷۸ درصد فرو بریزد.

در هر سه کشور، مدلهای هوش مصنوعی که برای نامزدهای راستگرا تبلیغ میکردند، بهطور مستمر ادعاهای غلط بیشتری نسبت به آنهایی داشتند که از نامزدهای چپگرا حمایت میکردند. رند میگوید این یافته منطقی است، زیرا مدل هوش مصنوعی، از اینترنت بهعنوان منبع ادعاهایش استفاده میکند و پژوهشهای قبلی نشان میدهد که کاربران رسانههای اجتماعی در سمت راست اطلاعات نادرست بیشتری نسبت به کاربران سمت چپ به اشتراک میگذارند.

دسته تکمیلیای از آزمایشها که نزدیک به ۷۷ هزار نفر را در بریتانیا درگیر میکرد، نشان داد که شرکتکنندگان بهطور برابر تحتتاثیر اطلاعات صحیح و غلطی قرار گرفتند که چتبات ارائه میکرد.

دیوید رَند، یکی از نویسندگان هر دو مطالعه و دانشمند علوم شناختی در دانشگاه کرنل در ایتاکا، نیویورک میگوید: یافتهها قدرت اقناعی چتباتها را نشان میدهد که بیش از صد میلیون کاربر هر روز از آنها استفاده میکنند.

هر دو مقاله دریافتند که چتباتها دیدگاههای رأیدهندگان را نه با استفاده از احساسات یا داستانسرایی، بلکه با بمباران کاربر با اطلاعات تحت تأثیر قرار میدهند. هرچه اطلاعات بیشتری که چتباتها ارائه کردند، قانع کنندهتر بودند، احتمال بیشتری داشت که ادعاهای نادرست تولید کنند.

لیزا آرگایل، دانشمند علوم اجتماعی محاسباتی در دانشگاه پردو در وستلافایت، ایندیانا میگوید: این میتواند هوش مصنوعی را به «چیزی بسیار خطرناک» تبدیل کند، به جای اینکه مردم آگاهتر شوند، این مردم هستند که بیشتر ناآگاه میشوند. او اضافه میکند که این مطالعات «دامنه چشمگیری» دارند. مقیاسی که آنها همهچیز را مطالعه کردهاند بسیار فراتر از چیزی است که معمولا در علوم اجتماعی انجام میشود.

برای فهم اینکه هوش مصنوعی تا چه اندازه میتواند در باورهای سیاسی قانع کننده باشد، پژوهشگران از نزدیک به ۶۰۰۰ شرکتکننده از سه کشور کانادا، لهستان و ایالات متحده خواستند که ترجیحات خود را درباره نامزدهای خاص در انتخابات رهبری کشورشان که در سال گذشته برگزار شده بود، در مقیاس صفر تا ۱۰۰ امتیازدهی کنند. سپس پژوهشگران شرکتکنندگان را بهصورت تصادفی تعیین کردند تا گفتوگوی رفتوبرگشتی با چتباتی داشته باشند که برای حمایت از یک سیاستمدار خاص طراحی شده بود. پس از این گفتوگو، شرکتکنندگان بار دیگر نظر خود را درباره آن نامزد، امتیازدهی کردند.

بیش از ۲۳۰۰ شرکتکننده در ایالات متحده این آزمایش را پیش از انتخابات ۲۰۲۴ بین رئیسجمهور دونالد ترامپ و معاون سابق رئیسجمهور کامالا هریس تکمیل کردند. وقتی نامزدی که چتبات برایش طراحی شده بود با ترجیح اولیه شرکتکننده متفاوت بود، امتیاز فرد بین دو تا چهار واحد به سوی آن نامزد تغییر پیدا میکرد. پژوهشهای قبلی نشان دادهاند که دیدگاههای مردم معمولا پس از دیدن تبلیغات سیاسی معمول کمتر از یک واحد تغییر میکند.

این اثر برای شرکتکنندگان در کانادا و لهستان که آزمایش را پیش از انتخابات کشورشان در اوایل امسال تکمیل کردند، بسیار قابل توجهتر بود: ترجیحات آنها بهطور متوسط حدود ۱۰ واحد پس از گفتوگو با چتبات به سمت نامزد دیگر منتقل شد. رند میگوید او از اندازه این اثر «کاملا مات و مبهوت» شده بود. او اضافه میکند که تأثیر چتباتها ممکن است در ایالات متحده ضعیفتر بوده باشد بهخاطر محیط سیاسی قطبی، که در آن مردم پیشفرضها و احساسات شدیدی نسبت به نامزدها دارند.

در همه کشورها، چتباتهایی که بر سیاستهای نامزد تمرکز داشتند، قانعکنندهتر از آنهایی بودند که بر شخصیتها تمرکز میکردند. به نظر میرسید که شرکتکنندگان زمانی بیشتر تحتتاثیر قرار میگیرند که چتبات شواهد و حقایق ارائه میداد. برای رایدهندگان لهستانی، درخواست از چتبات برای ارائه نکردن حقایق باعث شد قدرت اقناعی آن تا ۷۸ درصد فرو بریزد.

در هر سه کشور، مدلهای هوش مصنوعی که برای نامزدهای راستگرا تبلیغ میکردند، بهطور مستمر ادعاهای غلط بیشتری نسبت به آنهایی داشتند که از نامزدهای چپگرا حمایت میکردند. رند میگوید این یافته منطقی است، زیرا مدل هوش مصنوعی، از اینترنت بهعنوان منبع ادعاهایش استفاده میکند و پژوهشهای قبلی نشان میدهد که کاربران رسانههای اجتماعی در سمت راست اطلاعات نادرست بیشتری نسبت به کاربران سمت چپ به اشتراک میگذارند.

دسته تکمیلیای از آزمایشها که نزدیک به ۷۷ هزار نفر را در بریتانیا درگیر میکرد، نشان داد که شرکتکنندگان بهطور برابر تحتتاثیر اطلاعات صحیح و غلطی قرار گرفتند که چتبات ارائه میکرد.

مرجع : ايسنا