پایان اجلاس بلچلی با انتشار یک بیانیه

گفتوگوی جهانی درباره خطرات هوش مصنوعی شکل میگیرد

تاریخ انتشار

شنبه ۱۳ آبان ۱۴۰۲ ساعت ۱۰:۰۴

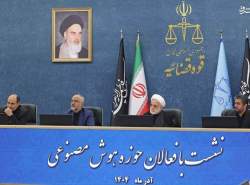

آیتیمن- اجلاس سران درباره ایمنی هوش مصنوعی، روزهای اول و دوم نوامبر به میزبانی دولت انگلیس و در پارک بلچلی با حضور نمایندگان و سران 28 کشور و اتحادیه اروپا، نمایندگانی از بخش خصوصی، دانشگاههای و جامعه مدنی برگزار شد.

کشورهای حاضر در این اجلاس، روز پنجشنبه با انتشار بیانیه پایانی این اجلاس، بر تدام همکاریها برای کاهش خطرات هوض مصنوعی تاکید کردند.

در این بیانیه همچنین تاکید شده که مشارکتکنندگان از شکلگیری یک شبکه فراگیر بینالمللی در مورد هوش مصنوعی مرزی حمایت خواهند کرد.

متن بیانیه اجلاس ایمنی هوش مصنوعی، موسوم به «بیانیه بلچلی» به این شرح است:

«هوش مصنوعی فرصتهای جهانی عظیمی ارائه میدهد: این هوش مصنوعی پتانسیل تغییر و ارتقای رفاه، صلح و رفاه انسان را دارد. برای درک این موضوع، ما تأیید میکنیم که برای خیر و صلاح همگان، هوش مصنوعی باید به گونهای طراحی، تولید، مستقر و استفاده شود که ایمن، انسان محور، قابل اعتماد و مسوولیتپذیر باشد. ما از تلاشهای جامعه بینالمللی برای همکاری در زمینه هوش مصنوعی و ترویج رشد اقتصادی فراگیر، توسعه پایدار و نوآوری، حمایت از حقوق بشر و آزادیهای اساسی، و تقویت اعتماد و اطمینان عمومیبه سیستمهای هوش مصنوعی برای تحقق کامل پتانسیل آنها استقبال میکنیم.

سیستمهای هوش مصنوعی در حال حاضر در بسیاری از حوزههای زندگی روزمره از جمله مسکن، اشتغال، حملونقل، آموزش، سلامت، دسترسی و عدالت مستقر شدهاند و احتمالاً استفاده از آنها افزایش مییابد. ما اذعان داریم که اکنون لحظهای منحصر به فرد برای اقدام و تأیید نیاز به توسعه ایمن هوش مصنوعی و استفاده از فرصتهای تحولآفرین هوش مصنوعی برای همه و بهطور فراگیر در کشورهای ما و در سطح جهانی است. این شامل خدمات عمومیمانند بهداشت و آموزش، امنیت غذایی، در علم، انرژی پاک، تنوع زیستی، و آب و هوا، تحقق بهرهمندی از حقوق بشر و تقویت تلاشها برای دستیابی به اهداف توسعه پایدار سازمان ملل میشود.

در کنار این فرصتها، هوش مصنوعی خطرات قابل توجهی را نیز به همراه دارد، از جمله در حوزههای زندگی روزمره. به این دلیل، ما از تلاشهای بینالمللی مرتبط برای بررسی و رسیدگی به تأثیر بالقوه سیستمهای هوش مصنوعی در مجامع موجود و سایر ابتکارات مرتبط استقبال میکنیم، و تاکید میکنیم که حفاظت از حقوق بشر، شفافیت و توضیحپذیری، انصاف، پاسخگویی، مقرراتگذاری، ایمنی، نظارت مناسب انسانی، اخلاق، کاهش سوگیری، حریم خصوصی و حفاظت از دادهها باید مورد توجه قرار گیرد. همچنین به احتمال خطرات پیشبینی نشده ناشی از توانایی دستکاری محتوا یا تولید محتوای فریبنده اشاره میکنیم. همه این موضوعات بسیار مهم هستند و ما بر ضرورت و فوریت رسیدگی به آنها تاکید میکنیم.

برخی از خطرات ایمنی در مرزهای هوش مصنوعی به وجود میآیند که آنها را مدلهای هوش مصنوعی بسیار توانمند میشناسیم. از جمله مدلهای پایه که میتوانند طیف گستردهای از وظایف را انجام دهند یا هوش مصنوعی محدود که ممکن است قابلیتهای آسیبزایی داشته باشند که با قابلیتهای موجود در پیشرفتهترین مدلهای امروزی مطابقت دارد یا از آن فراتر میرود. خطرات اساسی ممکن است ناشی از سوء استفاده عمدی بالقوه یا مسائل ناخواسته و نقایص کنترلی مربوط به همسویی با نیت انسان ناشی شود. این مسائل تا حدی به این دلیل است که آن قابلیتها به طور کامل درک نشدهاند و بنابراین پیش بینی آنها دشوار است. ما بهویژه نگران چنین خطراتی در حوزههایی مانند امنیت سایبری و بیوتکنولوژی و همچنین در مواردی هستیم که سیستمهای هوش مصنوعی مرزی ممکن است خطراتی مانند اطلاعات نادرست را تقویت کنند. احتمال آسیب جدی، حتی فاجعه بار، عمدی یا غیرعمدی وجود دارد که ناشی از مهمترین قابلیتهای این مدلهای هوش مصنوعی است. با توجه به نرخ سریع تحول هوش مصنوعی و شتاب سرمایهگذاری در فناوری، ما تأیید میکنیم که عمیقتر کردن درک خود از این خطرات بالقوه و اقدامات برای رسیدگی به آنها ضروری است.

بسیاری از خطرات ناشی از هوش مصنوعی ذاتاً ماهیت بینالمللی دارند و بنابراین بهتر است از طریق همکاری بینالمللی برطرف شوند. ما تصمیم داریم که به شکلی فراگیر با یکدیگر همکاری کنیم تا اطمینان حاصل شود که هوش مصنوعی انسانمحور، قابل اعتماد، مسوولیتپذیر و ایمن باشد و خیر عمومی را از طریق مجامع بینالمللی موجود و سایر ابتکارات مرتبط مورد حمایت قرار دهیم تا همکاریها را به منظور رسیدگی به خطرات گسترده ناشی از هوش مصنوعی تشویق کنیم. به این منظور، ما تایید میکنیم که کشورها باید اهمیت رویکرد نوآوریمحور، نظارت و راهبری مناسب و رویکرد مقرراتگذاری برای به حداکثر رساندن مزایا و کاهش خطرات هوش مصنوعی را در نظر بگیرند. این کار میتواند شامل طبقهبندی ریسک بر اساس شرایط ملی و چارچوبهای قانونی موجود باشد. ما همچنین به همکاری، در صورت لزوم، روی رویکردهایی مانند اصول مشترک و کدهای رفتاری تاکید میکنیم. با توجه به خطرات خاصی که به احتمال زیاد در رابطه با هوش مصنوعی مرزی به وجود میآید، ما تصمیم داریم به منظور شناسایی، درک و اقدام متناسب از طریق مجامع بینالمللی موجود و سایر ابتکارات مربوطه، از جمله از طریق اجلاسهای آینده امنیت هوش مصنوعی، به تقویت و حفظ همکاریها و گسترش آن به کشورهای دیگر بپردازیم.

همه بازیگران باید در تضمین ایمنی هوش مصنوعی نقش داشته باشند و کشورها، مجامع بین المللی و سایر ابتکارات، شرکتها، جامعه مدنی و دانشگاه باید با یکدیگر همکاری کنند. با توجه به اهمیت هوش مصنوعی فراگیر و پر کردن شکاف دیجیتال، مجدداً تأکید میکنیم که همکاری بینالمللی باید تلاش کند تا در صورت لزوم طیف وسیعی از شرکا را درگیر و مشارکت دهد و از رویکردها و سیاستهای توسعهمحور که میتواند به کشورهای در حال توسعه کمک کند و موجب ظرفیتسازی و بهرهگیری از هوش مصنوعی شود، استقبال کند. ما بر نقش فعال کننده هوش مصنوعی برای حمایت از رشد پایدار و رفع شکاف توسعه تاکید میکنیم.

ما تأیید میکنیم که در حالی که ایمنی باید در طول چرخه عمر هوش مصنوعی در نظر گرفته شود، بازیگرانی که قابلیتهای هوش مصنوعی مرزی را توسعه میدهند، به ویژه آن دسته از سیستمهای هوش مصنوعی که به طور غیرعادی قدرتمند و بالقوه مضر هستند، مسوولیت ویژهای برای تضمین ایمنی این سیستمها، از جمله از طریق ایجاد سیستمهایی برای آزمون ایمنی، ارزیابیها و سایر اقدامات متناسب دارند. ما تمامی بازیگران مرتبط را تشویق میکنیم که شفافیت و پاسخگویی متناسب با زمینه فعالیتشان را به منظور اندازهگیری، کنترل و کاهش قابلیتهای بالقوه آسیبزا و سایر آثار جانبی ممکن را به وجود بیاورند؛ به ویژه از سوءاستفاده و مسایل کنترلی و گسترش سایر خطرات جلوگیری کنند.

در چارچوب همکاری ما، و برای اطلاع رسانی اقدامات در سطوح ملی و بین المللی، دستور کار ما برای رسیدگی به خطرات هوش مصنوعی مرزی بر روی موارد زیر متمرکز خواهد بود:

مشخص کردن خطرات ایمنی هوش مصنوعی که نگرانی مشترک ماست، ایجاد درک مشترک علمی و مبتنی بر شواهد از این خطرات و حفظ این درک برای مواجهه با رشد مداوم قابلیتهای هوش مصنوعی در زمینه یک رویکرد جهانی گستردهتر برای شناسایی آثار هوش مصنوعی در جوامعمان.

تدوین سیاستهای مبتنی بر ریسک در کشورهایمان به منظور تضمین ایمنی در برابر چنین مخاطراتی، انجام همکاریهای لازم و در عین حال ادغان به اینکه رویکردها بر اساس مسایل ملی و چارچوبهای متناظر قانونی ممکن است متفاوت باشد. این مساله شامل افزایش شفافیت توسط بازیگران خصوصی است که قابلیتهای هوش مصنوعی مرزی را توسعه میدهند، معیارهای ارزیابی مناسب، ابزارهایی برای آزمایش ایمنی، و توسعه قابلیتهای بخش عمومی مرتبط و تحقیقات علمی میشود.

تدوین سیاستهای مبتنی بر ریسک در کشورهایمان به منظور تضمین ایمنی در برابر چنین مخاطراتی، انجام همکاریهای لازم و در عین حال ادغان به اینکه رویکردها بر اساس مسایل ملی و چارچوبهای متناظر قانونی ممکن است متفاوت باشد. این مساله شامل افزایش شفافیت توسط بازیگران خصوصی است که قابلیتهای هوش مصنوعی مرزی را توسعه میدهند، معیارهای ارزیابی مناسب، ابزارهایی برای آزمایش ایمنی، و توسعه قابلیتهای بخش عمومی مرتبط و تحقیقات علمی میشود.

در پیشبرد این دستور کار، ما تصمیم داریم از یک شبکه فراگیر بینالمللی از تحقیقات علمی در مورد ایمنی هوش مصنوعی مرزی حمایت کنیم که تکمیل کننده همکاریهای چندجانبه و دوجانبه موجود و جدید، از جمله از طریق مجامع بینالمللی موجود و سایر ابتکارات مربوطه، برای تسهیل ارائه بهترین دانش موجود برای سیاست گذاری و منافع عمومی خواهد بود.

با به رسمیت شناختن پتانسیل مثبت تحولآفرین هوش مصنوعی، و به عنوان بخشی از تضمین همکاری بینالمللی گستردهتر در زمینه هوش مصنوعی، ما تصمیم داریم یک گفتوگوی جهانی فراگیر را حفظ کنیم که مجامع بین المللی موجود و سایر ابتکارات مرتبط را درگیر کند، به شیوهای باز به بحثهای بینالمللی گستردهتر کمک کند، و ادامه تحقیقات در مورد ایمنی مرزی هوش مصنوعی و استفاده مسوولانه از مزایای این فناوری برای همه را تسهیل کند. ما مشتاقانه منتظر دیدار مجدد در سال 2024 هستیم.»

با به رسمیت شناختن پتانسیل مثبت تحولآفرین هوش مصنوعی، و به عنوان بخشی از تضمین همکاری بینالمللی گستردهتر در زمینه هوش مصنوعی، ما تصمیم داریم یک گفتوگوی جهانی فراگیر را حفظ کنیم که مجامع بین المللی موجود و سایر ابتکارات مرتبط را درگیر کند، به شیوهای باز به بحثهای بینالمللی گستردهتر کمک کند، و ادامه تحقیقات در مورد ایمنی مرزی هوش مصنوعی و استفاده مسوولانه از مزایای این فناوری برای همه را تسهیل کند. ما مشتاقانه منتظر دیدار مجدد در سال 2024 هستیم.»